Existentielles Klimarisiko

Die wissenschaftlichen Berichte und neoliberalen Politikentscheidungen der UN unterschätzen Klimabedrohungen.

Inhaltsverzeichnis

Englischsprachiges Original von David Spratt / Climate Code Red

Erstveröffentlichung d. Originals am 10. März 2019. Neuveröffentlichung mit freundlicher Genehmigung

Die internationale Klimapolitik hat es nicht geschafft, einen Pfad der katastrophalen Klimaerwärmung zu vermeiden. Zwei oft übersehene Gründe für dieses Versagen sind, wie Wissen zum Thema Klimawissenschaft von den zwei Klimaausschüssen der Vereinten Nationen – dem Intergovernmental Panel on Climate Change (IPCC) und der UN Framework Convention on Climate Change (UNFCCC) – produziert und genutzt worden ist und wie diese Gremien funktionieren.

Es ist nunmehr weithin akzeptiert, dass der menschengemachte Klimawandel dieses Jahrhundert ein existentielles Risiko für die menschliche Zivilisation darstellt. Wenn der CO2-Ausstoß nicht zeitnah auf null reduziert wird, ist es wahrscheinlich, dass der Klimawandel entweder alles intelligente Leben auslöschen oder sein Potential permanent und drastisch einschränken wird.

Während Politiker*innen darüber reden, die Erwärmung unter 1,5°C oder 2°C über dem vorindustriellen Level zu halten – ein sehr riskantes Ziel, wenn man bedenkt, dass gefährliche Kipppunkte bereits jetzt, mit nur 1°C Erwärmung, aktiviert werden – verdammen sie die Erde tatsächlich durch ihre Untätigkeit zu einem Pfad der weitaus stärkeren Erwärmung, die viele Städte, Nationen und Völker sowie viele, wenn nicht sogar die meisten, Spezies ausradieren wird.

Diese kognitive Dissonanz wurde besonders sichtbar beim vierundzwanzigsten Conference-of-the-Parties-Treffen (COP24) der UNFCCC in Katowice, Polen, im letzten Dezember [2018]. Die 16-jährige schwedische Klimaaktivistin Greta Thunberg, die die globale Bewegung der „Klimastreiks“ von Schüler*innen inspiriert hat, sprach vor der COP24 und bekam stehende Ovationen für ihre Rede, in der sie die Führungsschwäche der Erwachsenen bei COP kritisierte, welche ‚nicht reif genug‘ seien, um die Fakten beim Namen zu nennen:

Wir müssen deutlich sein, wie unangenehm es auch sein mag. Sie sprechen nur von ewigem – aber grünem – Wirtschaftswachstum (und) darüber, mit den gleichen schlechten Ideen weiterzumachen, die uns diesen Schlamassel erst eingebrockt haben, obwohl die einzige vernünftige Option ist, die Notbremse zu ziehen. Sie sind nicht reif genug, um den Tatsachen ins Auge zu sehen. Sogar diese Bürde müssen wir Kinder tragen.

Und dann gingen die Erwachsenen zum Geschäftlichen über und schrieben ein Regelbuch für das Pariser Abkommen. Das Resultat übt keinen Druck auf die beteiligten Staaten aus, die wenig ambitionierten Ergebnisse des COP von 2015 zu verbessern, und wiederholt stattdessen die Bitte, dass die Staaten ihre Verpflichtungen bis 2020 überarbeiten mögen.

Das Abkommen von Paris etablierte einen freiwilligen, nicht erzwingbaren ‚Bottom-up‘-Ansatz, in dem sich die Staaten zu Emissionsreduktionen verpflichteten, die zu einem Temperaturanstieg von 3,5°C führen würden – oder eher zu 5°C, wenn alle Feedbackschleifen des Klimasystems berücksichtigt werden. Ein derartiges Ergebnis ist laut Wissenschaftler*innen nicht mit dem Fortbestehen der menschlichen Zivilisation zu vereinbaren und könnte die menschliche Bevölkerung auf eine Milliarde schrumpfen lassen. Sogar die Weltbank sagt, dass ein derartiges Ergebnis jenseits dessen sei, woran sich die menschliche Zivilisation anpassen kann.

In einem Vorwort zum kürzlich erschienenen Report What Lies Beneath: The Underestimation of Existential Climate Risk warnt der anerkannte Wissenschaftler und Direktor Emeritus des Postdamer Instituts John Schellnhuber, dass ‚der Klimawandel nun sein Finale erreicht und die Menschheit sich sehr bald entscheiden muss, ob sie beispiellose Maßnahmen ergreift oder akzeptiert, dass es zu spät ist und die Konsequenzen erlitten werden müssen‘.

In einem Interview sagte Schellnhuber kürzlich, dass es, sollten wir so weitermachen wie bisher, ‚ein sehr großes Risiko‘ gebe, dass wir ‚unsere Zivilisation schlichtweg zerstören. Die Menschheit wird irgendwie überleben, aber wir werden fast alles zerstören, was wir über die letzten zweitausend Jahre hinweg aufgebaut haben.‘

UN Framework Convention on Climate Change

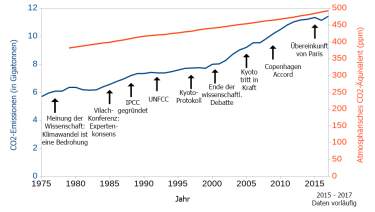

CO2-Emissionen & -Konzentration in der Atmosphäre

Seit die UNFCCC 1992 beim Rio Earth Summit gegründet wurde, sind die jährlichen von Menschen verursachten Kohlenstoffdioxidemissionen um mehr als 50 % gestiegen und es gibt keine Anzeichen, dass dieses Wachstum nachlässt Seit 1992 ist die Erwärmung von 0,6°C auf 1,1°C gestiegen, ein sich beschleunigender Trend, der die Erde innerhalb des nächsten Jahrzehnts ans untere Ende des in Paris beschlossenen Temperaturbereichs bringen dürfte. Basierend auf der bisherigen Klimageschichte der Erde ist anzunehmen, dass der heutige CO2-Gehalt den Meeresspiegel langfristig um dutzende Meter und die Temperatur um zivilisationszerstörende 3,5°C ansteigen lassen wird.

Die UNFCCC strebt danach, ‚ökonomischer Entwicklung zu erlauben, auf nachhaltige Weise stattzufinden‘, aber der ökologische Fußabdruck der Menschheit wird jedes Jahr weniger nachhaltig. Die Menschheit benötigt nunmehr jedes Jahr die biophysische Kapazität von 1,7 Erden und verbraucht im Eiltempo das Kapital der Natur.

Ein schnelles, notfallartiges Aufgeben der fossilen Energien ist ein absolut notwendiger Bestandteil einer angemessenen Reaktion auf den Klimawandel. Aber Politiker*innen ziehen Notfallhandlungen nicht in Erwägung, weil diese als ökonomisch zu riskant gesehen werden.

Zwei gute Beispiele für diese Einstellung finden sich in den ersten Berichten an ihre Regierungen von Nicholas Stern (Großbritannien, 2006) und Ross Garnaut (Australien, 2008). In diesen untersuchten sie die 450-Teilchen-pro-Million- (ppm) und 550-ppm-CO2-Ziele. 550 ppm würden ungefähr 3°C Erwärmung bedeuten, bevor die Feedbackschleifen des Kohlenstoffkreislaufs in Betracht gezogen werden. Eine derartige Erwärmung wäre verheerend für Mensch und Natur. Obwohl sowohl Stern als auch Garnaut zu dem Schluss kamen, dass 450 ppm – ungefähr 2°C Erwärmung ohne langfristige Systemrückkopplungen – bedeutend weniger Schaden verursachen würden, empfahlen sie dennoch, dass ihre Regierungen mit dem Ziel von 550 ppm anfangen sollten, weil sie der Meinung waren, dass das niedrigere Ziel ökonomisch zu riskant sei. Sie haben inzwischen eingestanden, dass neuere Beweise für einen sich beschleunigenden Klimawandel mit den dazugehörigen Folgen diese Herangehensweise fahrlässig erscheinen lassen.

Die Lehrmeinung der UNFCCC ist, dass noch Zeit für eine geordnete ökonomische Umorientierung innerhalb des momentanen neoliberalen Paradigmas bleibe und dass daher eng definierte kostenoptimierte Wege betont werden sollten. Poltiker*innen verlassen sich zunehmend auf integrierte Beurteilungsmodelle (IAMs), die behaupten, ökonomisch effiziente Optionen für Politik und Gesetzgebung vorschlagen zu können, deren wissenschaftliche Modelle aber materiell relevante Prozesse wie das Tauen des Permafrosts übersehen und die Kosten und das Ausmaß der zukünftigen Auswirkungen auf das Klima systematisch unterschätzen.

Politiker*innen favorisieren es außerdem, die Kohlenstoffverschmutzung zu kommerzialisieren und einen riesigen Markt zu erschaffen, der darauf basiert, das CO2 zu binden und unter der Erde zu lagern, eine in dieser Größenordnung unerprobte Technologie, die dennoch einen Boom für Öl- und Gasproduzenten schaffen würde. Unrealistische Annahmen über unerprobte Lösungen werden zu einem Vorwand, um entschlossene Aktion hinauszuzögern.

Entscheidungsträger*innen stellen sich in ihrem Wunschdenken einen Pfad der Schadensminderung vor, der über Jahrzehnte hinweg in einer wachsenden, wohlhabenden Welt erschaffen wird. Die Welt, die nicht in Betracht gezogen wird, ist die, in der wir leben: die Welt der heraufziehenden finanziellen Instabilität; der globalen Krise politischer Legitimität; der nicht-linearen Aspekte des Klimasystems; der Nachhaltigkeitskrise, die weit über den Klimawandel hinausgeht und all die Grundfesten der menschlichen Existenz und, wichtiger noch, der Grenzen des Planeten (Boden, Trinkwasser, Meere, die Atmosphäre, Artenvielfalt usw.) betrifft.

Das Pariser Abkommen beinhaltet fast keine sachlichen Aussagen über die Ursachen des menschengemachten Klimawandels und keine Verweise auf „Kohle“, „Öl“, „Fracking“, „Schieferöl“, „fossile Brennstoffe“ oder „Kohlenstoffdioxid“ oder auf die Wörter „null“, „verbieten“ oder „aufhören“. Zum Vergleich: der Ausdruck „Anpassung“ kommt mehr als achtzig Mal auf einunddreißig Seiten vor, die Verantwortung dafür, andere dazu zu zwingen, sich anzupassen, wird dagegen nicht erwähnt und sowohl Haftung als auch Schadensausgleich wird explizit ausgeschlossen. Das Abkommen hat ein Ziel aber keinen festen Aktionsplan und ist voll von bürokratischem Jargon; die Ausdrücke „verbessern“ und „Kapazität“ kommen jeweils über fünfzig Mal vor.

UNFCCC

In gewisser Hinsicht sollte das angesichts der Struktur der UNFCCC niemanden überraschen. Die COPs sind politische Foren, die von Berufsdiplomat*innen der staatlichen Regierungen bevölkert werden und die von diplomatischen Verhandlungen, Kompromissen und Deals geprägt sind. Die Entscheidungsfindung ist inklusiv (konsensbasiert), was die Ergebnisse zu den Geiseln von staatlichen Interessen und dem Prozess, den kleinsten gemeinsamen Nenner zu finden, werden lässt. Dies wurde in Polen wieder einmal deutlich, als vier große Öl- und Gasproduzenten – Saudi-Arabien, die USA, Kuwait und Russland – in einem tödlichen diplomatischen Streik das formelle Willkommenheißen eines wissenschaftlichen Berichts über das Ziel von 1,5°C blockierten, den die COP drei Jahre zuvor in Paris in Auftrag gegeben hatte. Derartiges Verhalten ist typisch für COP-Treffen.

Diskussionen über das, was sicher wäre – weniger Erwärmung, als wir im Moment erleben – ist nicht-existent. Wenn Klimawandel jetzt schon gefährlich ist, hat die UNFCCC ihr Hauptziel, ‚gefährlichen menschengemachten Einfluss auf das Klimasystem‘ zu verhindern, aufgegeben, als sie ihr Temperaturziel von 1,5°C auf 2°C geändert hat.

Interessenkonflikte durchdringen das Denken der Amtsträger*innen: es gibt einen Anreiz, Risiken im Interesse der politischen Zweckdienlichkeit zu ignorieren. Und deshalb haben wir ein Politikversagen von epischen Ausmaßen.

Die Zurückhaltung der Wissenschaft

Die Unfähigkeit, das existentielle Risiko, dem wir uns gegenüber sehen, zu begreifen und damit aktiv umzugehen, ist teilweise ein Produkt der Art, wie Wissen im Bereich der Klimawissenschaft produziert wird. Ein Großteil der Klimaforschung tendiert traditionell dazu, diese existentiellen Risiken herunterzuspielen und hat eine Vorliebe für konservative Prognosen und intellektuelle Zurückhaltung gezeigt, obwohl eine zunehmende Anzahl Wissenschaftler*innen – unter anderem Kevin Anderson, James Hansen, Michael E. Mann, Michael Oppenheimer, Naomi Oreskes, Stefan Rahmstorf, Eric Rignot und Will Steffen – sich in den letzten Jahren zu den Gefahren einer solchen Herangehensweise geäußert haben.

Eine Studie, die eine Vielzahl vergangener Prognosen von Klimawissenschaftler*innen untersucht hat, kam zu dem Schluss, dass diese ‚konservativ‘ gewesen seien, was ihre Prognosen bezüglich der Auswirkungen des Klimawandels anging, und dass ‚zumindest einige der Hauptattribute der Klimaerwärmung durch angestiegene atmosphärische Treibhausgase unterschätzt wurden, besonders in IPCC-Einschätzungen der naturwissenschaftlichen Erkenntnisse‘. Die Autor*innen kamen zu dem Schluss, dass Klimawissenschaftler*innen nicht zum Überdramatisieren tendierten, sondern sich im Gegenteil ‚im Zweifelsfall lieber so wenig dramatisch wie möglich ausdrücken‘, dass ‚zu ihren Beweggründen eventuell gehört, dass sie sich an wissenschaftliche Normen wie Zurückhaltung, Objektivität, Rationalität, Distanz, Mäßigung und Skeptizismus halten wollen.‘ Dies kann dazu führen, dass Wissenschaftler*innen ‚zukünftige Klimaveränderungen unterschätzen oder verharmlosen‘.

Ähnliches berichtet Garnaut, der der australischen Regierung zwei Klimaberichte vorlegte. Garnaut untersuchte, ob die Klimawissenschaft eine systemische ‚konservative Tendenz‘ habe, die einer gewissen ‚intellektuellen Zurückhaltung‘ geschuldet ist, und beobachtete, dass dies im Feld der Klimawissenschaft mit einem ‚Unterschätzen von Risiken‘ einhergehe.

Wenn es darum geht, wie mit existentiellen Klimarisiken umgegangen wird, hat Schellnhuber auf die Grenzen von Methoden hingewiesen, die sich auf Risiko und Wahrscheinlichkeitsanalyse konzentrieren und deshalb häufig die statistischen Ausreißer ignorieren – Ereignisse und Möglichkeiten, die unwahrscheinlicher sind, aber große Auswirkungen hätten:

Expert*innen tendieren dazu, ein unter Kolleg*innen geteiltes Weltbild zu erschaffen, das immer rigider und klarer umrissen wird. Aber die wichtigsten Erkenntnisse bezüglich des fraglichen Themas lauern vielleicht in den Randgebieten. Das trifft insbesondere dann zu, wenn es um das Überleben unserer Zivilisation geht, ein Thema, bei dem konventionelle Analysemethoden nutzlos werden können.

Er hat auf eine ‚Besessenheit mit Wahrscheinlichkeit‘ hingewiesen, im Zuge derer Wissenschaftler*innen versucht haben, das komplexe, stochastische Verhalten eines Objekts festzuhalten, indem das gleiche Experiment mit dem Objekt viele, viele Male wiederholt wurde.

Wir dürfen niemals vergessen, dass wir in einer beispiellosen Situation sind, für die es keine genaue historische Analogie gibt. Das Niveau der Treibhausgase in der Atmosphäre ist heute höher und die Erde wärmer als je zuvor in der Menschheitsgeschichte. Und es leben nunmehr fast acht Milliarden von uns auf diesem Planeten. Daher ergibt es in den kritischsten Umständen wenig Sinn, Wahrscheinlichkeiten zu berechnen. So zum Beispiel bei den Methanabgabedynamiken von tauendem Permafrost oder der Möglichkeit, dass durch die Klimakrise ganze Nationen zu gescheiterten Staaten werden. Stattdessen sollten wir Möglichkeiten identifizieren, das bedeutet potentielle Entwicklungen der Gegebenheiten auf dem Planeten, die zu den Umständen, den Prozessen und der Triebfedern, die wir kennen, passen.

Kevin Anderson von der University of Manchester sagt, dass es ‚eine endemische Tendenz unter vielen Leuten, die Emissionsszenarien erstellen,‘ gebe, ‚die Größenordnung der Herausforderung zu unterschätzen, vor die uns 2°C Erwärmung stellen würde.‘ In vielerlei Hinsicht zensieren diese Wissenschaftler*innen ihre eigenen Forschungsergebnisse, um sich dem dominanten politischen und ökonomischen Paradigma anzupassen.‘

Ein gutes Beispiel ist das Ziel von 1,5°C, auf das sich bei der Klimakonferenz in Paris im Dezember 2015 geeinigt wurde. Die IPCC-Berichte hatte bis zu dem Zeitpunkt (in Übereinkunft mit dem dominanten politischen Paradigma) den 1,5°C-Emissionsreduktionsszenarien und deren Auswirkungen wenig Aufmerksamkeit geschenkt und die Delegierten in Paris mussten das IPCC mit großer Dringlichkeit darum bitten. Die Politik dominiert die Wissenschaft: Hier wedelt der Schwanz mit dem Hund.

Intergovernmental Panel on Climate Change

Das IPCC produziert Zusammenfassungen von wissenschaftlichen Erkenntnissen in erster Linie, um eine Faktenbasis für Politik und Gesetzgebung zu schaffen, besonders für die UNFCCC. Dies kann als ‚Wissenschaft für die Behörden‘ bezeichnet werden (im Gegensatz zu ‚Wissenschaft für die Forschung‘), und Sheila Jasanoff beschreibt dies als eine Wissenschaft, die ‚mit einem Bein in der Wissenschaft und mit einem in der Politik steht‘, da Wissenschaftler*innen und Regulierungsbehörden versuchen, Antworten auf politisch relevante Fragen zu finden. In dieser Auseinandersetzung zwischen Wissenschaft und Politik wird Wissenschaft laut Kate Dooley und ihren Co-Autor*innen ‚weder als objektive Wahrheit noch als von sozialen Interessen dominiert gesehen, sondern als gemeinsames Produkt von natürlichen und sozialen Ordnungen.‘

Diese gemeinsame Produktion hat zu vielen der charakteristischen Eigenschaften der IPCC-Arbeit geführt und zeigt sich in der Art, wie die Organisation 1988 gegründet wurde. Es gab Spannungen zwischen dem Wunsch von UN-Mitgliedsstaaten, die Ergebnisse des Gremiums politischen Prozessen zu unterwerfen, und der Notwendigkeit, glaubwürdige Wissenschaftler*innen als Leiter*innen eines von Spezialist*innen geleiteten Prozesses des Synthetisierens von und Berichtens über Klimawissenschaft zu haben. Einige Staaten, wie die USA, waren besorgt, dass ‚die Ozonverhandlungen es Expert*innen erlaubt haben, den politischen Realitäten vorzugreifen; sie wollten eine strengere Kontrolle über die Wissensproduktion des Gremiums ausüben, indem sie die Mitglieder selbst ernennen würden.‘.

Der Kompromiss war, dass Wissenschaftler*innen die langen Syntheseberichte schreiben würden, aber dass die kürzeren Zusammenfassungen für Entscheidungsträger*innen in Plenarsitzungen Zeile für Zeile von Diplomat*innen abgenickt oder einem Veto unterzogen wurden. Diese Methode hat historisch dazu geführt, dass die wissenschaftlichen Erkenntnisse stark verwässert wurden. Außerdem haben Regierungsvertreter*innen das letzte Wort bei allen Handlungen, einschließlich der Veröffentlichung aller Berichte, und der Ernennung des oder der wissenschaftlichen Hauptautor*in aller Berichte. Letzteres hat zu dem zurückhaltendem Ton eines großen Teils der Hauptarbeit des IPCC geführt.

Bereits als der erste IPCC-Bericht im Jahre 1990 geschrieben wurde, wurden die Delegierten der USA, Saudi-Arabien und Russland aktiv, ‘schwächten die Besorgnis in der Wortwahl ab und verstärkten das Moment der Unsicherheit‘, wie Jeremy Leggett berichtet. Martin Parry vom Met Office [einem britischen Wettervorhersagedienst, d.Ü.], damaliger Co-Vorsitzender einer IPCC-Arbeitsgruppe, brachte die Streits zwischen Wissenschaftler*innen und politischen Amtsträger*innen über die 2007er Zusammenfassung für Entscheidungsträger*innen an die Öffentlichkeit: ‚Regierungen mögen keine Zahlen, also wurden einige Zahlen gestrichen.‘

Wie die UNFCCC leidet auch der Prozess des IPCC an den Gefahren von konsensorientierter Entscheidungsfindung in einer komplexen Arena. Es ist der Sache geschuldet, dass IPCC-Berichte nicht immer die neusten verfügbaren Informationen beinhalten, und Konsensfindung kann zu Ergebnissen führen, die vor allem Streit vermeiden sollen und sich auf den kleinsten gemeinsamen Nenner konzentrieren, kritische Themen aber dagegen übersehen. Das ist insbesondere der Fall für die schweren Ränder von Wahrscheinlichkeitsverteilungen – Ereignisse mit niedrigerer Wahrscheinlichkeit aber großen Auswirkungen, bezüglich derer nicht viele wissenschaftliche Erkenntnisse vorliegen.

Die Grenzen von Klimamodellen

Von Anfang an hat das IPCC sein Klimaverständnis aus generellen Zirkulationsmodellen (GZMs) bezogen und andere Wissensquellen ignoriert. Dies hat zu weitreichenden Konsequenzen geführt, unter anderem zu der Zurückhaltung des IPCC zu Schlüsselthemen und einer Unfähigkeit, mit Risikofragen umzugehen. Dooley hat angemerkt, dass Forscher*innen seit mehr als zwei Jahrzehnten:

die Nützlichkeit von GZM für Politikfindung in Frage stellen, da diese Schwächen in Fragen der Unsicherheit aufweisen. Sie argumentieren, dass die Dominanz von Modellen – die weithin als die „beste wissenschaftliche Grundlage“, die für Klimapolitik verfügbar ist, wahrgenommen werden – zu einer Hinorientierung zu einem technokratischen Politikverständnis führt, welches politische Entscheidungen vertuscht, die eine umfangreichere Debatte verdienen würden. Es gibt inzwischen einen etablierten Literaturbestand, der die Implikationen dieser expertendominierten, modelbasierten Herangehensweise an Klimapolitik kritisiert.

Dooley und Co-Autor*innen sagen, dass die Forschung inzwischen demaskiert habe, wie diese Herangehensweise in die Wissenschaft eingebaut wird und ein technokratisches und globales Framing des Klimawandels erlaubt, in dem Menschen und Auswirkungen nicht vorkommen.

Es gibt ein konsistentes Muster beim IPCC: Detaillierte, quantitative (zahlenbasierte) Resultate von komplexen Modellen werden präsentiert, aber extremere Möglichkeiten – wie Feedbacks, die die Modelle nicht erfassen – werden nur kurz und in nicht quantitativer Form beschrieben. Der Meeresspiegel, das Eis an den Polkappen und einige Feedbacks des Kohlenstoffkreislaufs sind drei Beispiele. Weil politische Entscheidungsträger*innen und die Medien oft Zahlen in den Mittelpunkt stellen, führt diese Herangehensweise dazu, dass den verheerendsten, nichtlinearen und schwer zu quantifizierenden Resultaten wenig Aufmerksamkeit geschenkt wird.

Vor zwölf Jahren betonten Oppenheimer und seine Co-Autor*innen, dass ein Konsens um numerische Resultate herum zu einer Unterschätzung von Risiken führen könne:

Die Konsensorientierung von IPCC-Berichten hat den Fokus auf die zu erwartenden Resultate gelenkt, die dann durch numerische Schätzungen im Hinterkopf von Entscheidungsträger*innen verankert wurden […] Es ist nunmehr ebenso wichtig, dass Politiker*innen die extremeren Möglichkeiten verstehen, die der Konsens vielleicht ignoriert oder herunterspielt […] Da numerische Werte sich unweigerlich verankern, muss die Basis für Schätzungen zu quantitativer Unsicherheit breiter angelegt werden.

Oppenheimer und seine Co-Autor*innen schreiben, dass Indizien aus der Klimageschichte der Erde ein Gewicht zugestanden werden sollte, das mit dem weniger komplexer, semi-empirischer Modelle, die eher auf Beobachtung basieren, und theoretischer Beweise für wenig verstandene Phänomene vergleichbar ist. Und sie drängen das IPCC dazu, „Expertenurteile“ in Betracht zu ziehen, mit anderen Worten, was angesehene Persönlichkeiten aus der Wissenschaft über Themen denken, zu denen es noch nicht genügend – oder hinreichend konsistente – Beweise gibt, dass diese den Peer-Review-Prozess bestehen können. Das ist bisher nicht geschehen.

Ein falsches Risikoverständnis

Wir haben bereits gesehen, wie wissenschaftliche Zurückhaltung und konsensbasierte politische Entscheidungsfindung zur Unterschätzung von Risiko führen. Die IPCC-Berichte haben extremere Möglichkeiten unterschätzt und es nicht geschafft, Risiken auf ausgewogene Weise zu untersuchen. Stern kommentiert den fünften Assessment-Report des IPCC mit den Worten: „Er hat praktisch über einen Literaturbestand berichtet, der die Risiken [und Kosten] eines schlecht gehandhabten Klimawandels grob und systematisch unterschätzt hat.“

Das ist besonders besorgniserregend, wenn es um Kipppunkte des Klimasystems – kritische Schwellen, deren Überschreitung zu plötzlichen, starken Änderungen im Klimasystem führt – geht, wie die Polkappen (und dadurch der Meeresspiegel), den Permafrost und andere Kohlenstoffspeicher, alles Aspekte, bei denen die Auswirkungen der Klimaerwärmung nicht-linear und schwer auf Basis des momentanen wissenschaftlichen Wissens in Modelle zu übertragen sind.

Von großer Wichtigkeit ist das Problem von Risiken an den schweren Enden der Wahrscheinlichkeitskurven, die zwar weniger wahrscheinlich sind, bei denen aber die Wahrscheinlichkeit von sehr schwerwiegenden Auswirkungen größer ist, als man unter normalen statistischen Annahmen vermutet würde. Diese möglichen Risiken für die Menschheit, die die Kipppunkte darstellen, rechtfertigen entschlossene Vorsichtsmaßnahmen. Wenn die Klimapolitik auf einem festen Fundament stehen soll, ist ein neues Framing der wissenschaftlichen Forschung in einem Rahmen des Managements von existentiellen Risiken dringend notwendig.

Aber das ist nichtmal auf dem Radar der Klimagremien der UN, die der Analyse von Risiken an den schweren Enden keine Aufmerksamkeit schenken und deren Methoden, eine beachtliche Bandbreite an Forschung mit divergierenden Ergebnissen zu synthetisieren, die häufigeren Ergebnisse in den Vordergrund stellt, die eher in der Mitte der Ergebnisskala sind.

Eine umsichtige Herangehensweise an Risikomanagement bedeutet, den realen Risiken, denen wir ausgesetzt sind, ins Auge zu sehen und sie objektiv zu beurteilen. Besonders trifft das auf die Ereignisse zu, deren Konsequenzen so große Schäden verursachen würden, dass diese nicht mehr zu quantifizieren wären, und die die menschliche Zivilisation, wie wir sie kennen, nur mit Glück überleben würde. Es ist wichtig, das Potential des schlimmsten Ernstfalls zu verstehen und dafür zu planen (und dann hoffentlich positiv überrascht zu sein, wenn er nicht eintrifft). Wenn wir uns auf die wahrscheinlichsten Ergebnisse konzentrieren und die extremeren Möglichkeiten ignorieren, kann dies zu einer unerwarteten Katastrophe führen, die wir vorhersehen hätten können und sollen.

Hat Nicht-Linearität einen Vorteil?

Das Problem bei nicht-linearen Änderungen im Klimasystem ist, dass sie, fast schon per Definition und auch aufgrund des momentanen Entwicklungszustands von Klimamodellen, schwer vorauszusagen sind. Obwohl die Klimageschichte der Erde wertvolle Einblicke in unsere nahe Zukunft bieten kann, hat das IPCC diese wichtigen Forschungsergebnisse bezüglich des Spielraums von möglichen zukünftigen Entwicklungen des Klimas heruntergespielt, oft geradezu ignoriert.

Der Hurrikan Harvey — Houston, Texas, USA — August 2017

Das Feld der Paläoklimatologie hat gezeigt, dass langfristig jedes Grad Erwärmung zu 10 bis 20 Meter Ansteigen des Meeresspiegels führt und dass das momentane Niveau an Treibhausgasen ausreichend ist, um eine Erwärmung zu verursachen, die die menschliche Zivilisation, wie wir sie kennen, vermutlich beenden würde: durch Überflutung der seenahen Städte und Siedlungen sowie der Flussdeltas, wo die Nahrung der Menschheit angebaut wird, durch Erwärmung, die die meisten tropischen Gebiete der Welt (wie den Großteil von Süd-, Südost- und Ostasien) unbewohnbar machen würde und durch eine Zerstörung der Ordnung in und zwischen Nationen.

Physische, nicht-lineare Störungen des Klimasystems kommen auf uns zu. Aber es gibt auch soziale, ökonomische und psychologische Kipppunkte, die eine sehr viel schnellere Reaktion auf den Klimawandel auslösen könnten. Der schnell wachsende Enthusiasmus in den USA für den Green New Deal, der von der gerade gewählten Kongressabgeordneten Alexandria Ocasio-Cortez verfochten wird, könnte ein solcher Moment sein. (Fossile Energien abschalten kommentiert: auch wenn grüne Technologie nicht genug ist)

Große Änderungen werden uns laut Schellnhuber zwingen, „eine Liste von Optionen zusammenzustellen […] von disruptiven Innovationen, selbstverstärkenden Innovationen“. Er schreibt, dass diese Optionen nicht genau vorhergesagt werden könnten und dass wir sehen müssten, ob es bei einer Reihe sich gerade herauskristallisierender Technologien große nicht-lineare Potentiale gibt.

Derartige Innovationen sind ein wichtiges Element für jede Herangehensweise, die die ganze Gesellschaft mit einbezieht und von der Regierung gesteuert werden, wie es beim Green New Deal der Fall ist, der eine Mobilisierung auf dem Niveau von Kriegsproduktion notwendig werden ließe, um eine emissionsfreie Ökonomie zu schaffen und gleichzeitig Arbeitsplätze und Gerechtigkeit sicherzustellen.

Schellnhuber schreibt, das Problem sei der konventionelle Ökonom, der „effizient sein will, aber Effizienz ist der Feind von Innovation“. Rapide Innovation in Krisenzeiten, wenn es schnell gehen muss, bedeutet, dass mehrere Innovationsstränge gleichzeitig verfolgt werden, da nach vielen Antworten gleichzeitig gesucht wird. Einige dieser Stränge werden sich als nicht hilfreich erweisen und Kapital wird verschwendet werden, aber die Erfolge werden zu „dem Wandel, den wir brauchen“ führen.

Er schreibt, dass wir nunmehr Risikokapital im globalen Maßstab ansammeln müssen, denn „wir kommen nicht auf effiziente Weise aus dieser Misere heraus“. Das bedeutet:

Wir müssen die Welt retten, aber wir müssen sie auf eine verworrene, chaotische, teure Art retten. Das ist die Quintessenz. Wenn wir es auf [ökonomisch] optimale Weise versuchen, werden wir es nicht schaffen.

Derartiges Denken würde eine revolutionäre Überwindung der neoliberalen Normen der UNFCCC notwendig werden lassen. Vielleicht ist das nicht möglich und das Gremium kann keine nützliche Rolle mehr spielen. Zweckdienlichere Mechanismen zu entwickeln ist heute eine dringende Aufgabe.

Unterstütze unsere Arbeit, indem du unserer Mailingliste betrittst, diese Seite teilst oder „likst“ und uns auf den sozialen Medien folgst.